BTC/HKD+6.59%

BTC/HKD+6.59% ETH/HKD+10.47%

ETH/HKD+10.47% LTC/HKD+5.25%

LTC/HKD+5.25% ADA/HKD+9.21%

ADA/HKD+9.21% SOL/HKD+10.15%

SOL/HKD+10.15% XRP/HKD+10.34%

XRP/HKD+10.34%ChatGPT是個啥?

近期,OpenAI發布了ChatGPT,是一個可以對話的方式進行交互的模型,因為它的智能化,得到了很多用戶的歡迎。ChatGPT也是OpenAI之前發布的InstructGPT的親戚,ChatGPT模型的訓練是使用RLHF也許ChatGPT的到來,也是OpenAI的GPT-4正式推出之前的序章。

什么是GPT?從GPT-1到GPT-3

GenerativePre-trainedTransformer(GPT),是一種基于互聯網可用數據訓練的文本生成深度學習模型。它用于問答、文本摘要生成、機器翻譯、分類、代碼生成和對話AI。

2018年,GPT-1誕生,這一年也是NLP的預訓練模型元年。性能方面,GPT-1有著一定的泛化能力,能夠用于和監督任務無關的NLP任務中。其常用任務包括:

自然語言推理:判斷兩個句子的關系問答與常識推理:輸入文章及若干答案,輸出答案的準確率語義相似度識別:判斷兩個句子語義是否相關分類:判斷輸入文本是指定的哪個類別雖然GPT-1在未經調試的任務上有一些效果,但其泛化能力遠低于經過微調的有監督任務,因此GPT-1只能算得上一個還算不錯的語言理解工具而非對話式AI。

CryptoQuant分析師:目前火幣儲備設置風險很高,凈儲備占比56.7%:12月19日消息,CryptoQuant近期的一份報告中披露了各個加密交易所的儲備質量(除去交易所代幣的資產占比)數據,其中OKX凈儲備占比100%,幣安的凈儲備約占89%,而火幣僅占56.7%。CryptoQuant的作者兼分析師之一CaueOliveria在給CoinDesk的一份報告中寫道:“火幣儲備目前的設置風險很高,公司本身發行的代幣對公司的網絡健康構成威脅,因為很難維持這些代幣發行的真實性。”他認為,FTX使用FTT來抵押貸款是其失敗的原因之一,而火幣正在玩“一場危險的游戲”。

但CoinGecko的聯合創始人兼首席運營官BobbyOng認為,了解火幣的負債才能正確了解情況。“如果交易所不使用其抵押品來借錢,如果每個客戶的加密貨幣都以1:1的比例完全存放在適當的錢包中,那么凈準備金是多少并不重要,更重要的是了解交易所的負債金額。”(CoinDesk)[2022/12/19 21:53:35]

GPT-2也于2019年如期而至,不過,GPT-2并沒有對原有的網絡進行過多的結構創新與設計,只使用了更多的網絡參數與更大的數據集:最大模型共計48層,參數量達15億,學習目標則使用無監督預訓練模型做有監督任務。在性能方面,除了理解能力外,GPT-2在生成方面第一次表現出了強大的天賦:閱讀摘要、聊天、續寫、編故事,甚至生成假新聞、釣魚郵件或在網上進行角色扮演通通不在話下。在“變得更大”之后,GPT-2的確展現出了普適而強大的能力,并在多個特定的語言建模任務上實現了彼時的最佳性能。

ETHVietnam二次方資助輪次啟動:12月2日消息,ETH越南黑客馬拉松二次方資助輪次在DoraHacks.io啟動。經過主辦方篩選,11個獲勝項目進入二次方資助,分配價值5000美金的二次方獎金池,并接受社區捐助。

在ETHVietnam會議上,George Pagonis介紹了Dora過去兩年在以太坊社區的基礎設施構建工作,呼吁社區在以太坊網絡自由建設原創性的應用,并介紹了即將開始的以太坊研究資助計劃(ETH Research Grant)。[2022/12/2 21:18:44]

之后,GPT-3出現了,作為一個無監督模型,幾乎可以完成自然語言處理的絕大部分任務,例如面向問題的搜索、閱讀理解、語義推斷、機器翻譯、文章生成和自動問答等等。而且,該模型在諸多任務上表現卓越,例如在法語-英語和德語-英語機器翻譯任務上達到當前最佳水平,自動產生的文章幾乎讓人無法辨別出自人還是機器,更令人驚訝的是在兩位數的加減運算任務上達到幾乎100%的正確率,甚至還可以依據任務描述自動生成代碼。一個無監督模型功能多效果好,似乎讓人們看到了通用人工智能的希望,可能這就是GPT-3影響如此之大的主要原因

工信部:加快標識與5G、區塊鏈等新技術的融合創新:金色財經報道,2022中國5G+工業互聯網大會19日在武漢召開。工業和信息化部信息通信管理局一級巡視員王鵬在其間的工業互聯網標識論壇上表示,工業和信息化部將繼續夯實標識解析體系基礎設施建設,加快標識與5G、區塊鏈、人工智能等新技術的融合創新,提升國家頂級結點互聯互通能力和服務水平。

?工業和信息化部還將持續完善二級節點、遞歸結點的建設,加快推進企業內外網絡的改造和建設,引導各類服務節點完善技術和服務能力,逐步降低標識應用以及系統改造的成本。(上證報)[2022/11/19 22:06:48]

GPT-3模型到底是什么?

實際上,GPT-3就是一個簡單的統計語言模型。從機器學習的角度,語言模型是對詞語序列的概率分布的建模,即利用已經說過的片段作為條件預測下一個時刻不同詞語出現的概率分布。語言模型一方面可以衡量一個句子符合語言文法的程度,同時也可以用來預測生成新的句子。例如,對于一個片段“中午12點了,我們一起去餐廳”,語言模型可以預測“餐廳”后面可能出現的詞語。一般的語言模型會預測下一個詞語是“吃飯”,強大的語言模型能夠捕捉時間信息并且預測產生符合語境的詞語“吃午飯”。

WhaleAlert:6800萬枚USDT從未知錢包轉移至火幣:金色財經消息,據Whale Alert數據顯示,68,000,000枚USDT(約68,169,022美元)從“TDtHxG”開頭地址錢包轉移至火幣。[2022/9/4 13:07:44]

通常,一個語言模型是否強大主要取決于兩點:首先看該模型是否能夠利用所有的歷史上下文信息,上述例子中如果無法捕捉“中午12點”這個遠距離的語義信息,語言模型幾乎無法預測下一個詞語“吃午飯”。其次,還要看是否有足夠豐富的歷史上下文可供模型學習,也就是說訓練語料是否足夠豐富。由于語言模型屬于自監督學習,優化目標是最大化所見文本的語言模型概率,因此任何文本無需標注即可作為訓練數據。

由于GPT-3更強的性能和明顯更多的參數,它包含了更多的主題文本,顯然優于前代的GPT-2。作為目前最大的密集型神經網絡,GPT-3能夠將網頁描述轉換為相應代碼、模仿人類敘事、創作定制詩歌、生成游戲劇本,甚至模仿已故的各位哲學家——預測生命的真諦。且GPT-3不需要微調,在處理語法難題方面,它只需要一些輸出類型的樣本。可以說GPT-3似乎已經滿足了我們對于語言專家的一切想象。

世界經濟論壇被列為Celsius債權人之一:金色財經報道,鏈上分析師DylanLe Clair發推稱,世界經濟論壇被列為Celsius債權人之一。此前消息,Celsius第二次聽證會時間推遲至北京時間8月17日2:00。[2022/8/5 12:04:38]

注:上文主要參考以下文章:1.GPT4發布在即堪比人腦,多位圈內大佬坐不住了!-徐杰承、云昭-公眾號51CTO技術棧-2022-11-2418:082.一文解答你對GPT-3的好奇!GPT-3是什么?為何說它如此優秀?-張家俊中國科學院自動化研究所2020-11-1117:25發表于北京3.TheBatch:329|InstructGPT,一種更友善、更溫和的語言模型-公眾號DeeplearningAI-2022-02-0712:30

GPT-3存在什么問題?

但是GTP-3并不完美,當前有人們最擔憂人工智能的主要問題之一,就是聊天機器人和文本生成工具等很可能會不分青紅皂白和質量好壞,地對網絡上的所有文本進行學習,進而生產出錯誤的、惡意冒犯的、甚至是攻擊性的語言輸出,這將會充分影響到它們的下一步應用。

OpenAI也曾經提出,會在不久的將來發布更為強大的GPT-4:

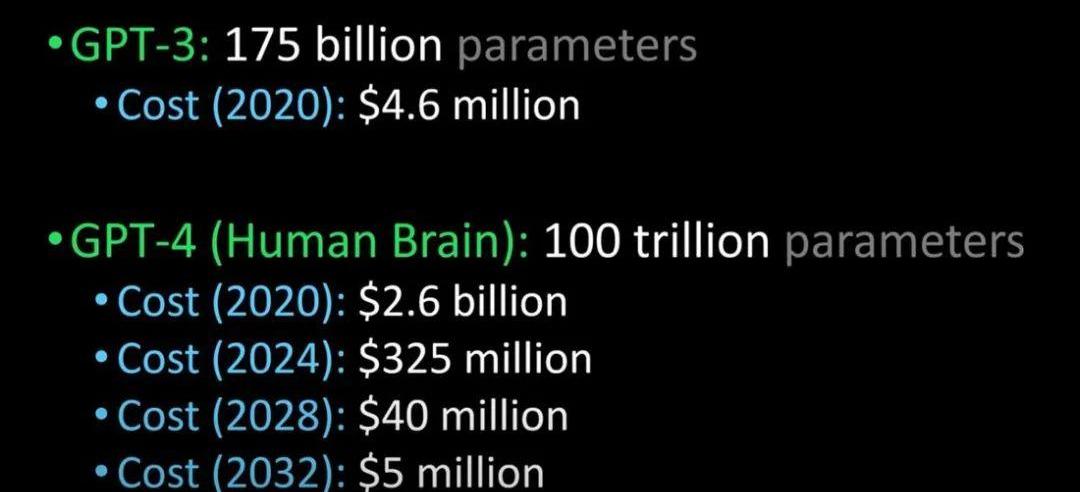

將?GPT-3與GPT-4、?人腦進行比較

據說,GPT-4會在明年發布,它能夠通過圖靈測試,并且能夠先進到和人類沒有區別,除此之外,企業引進GPT-4的成本也將大規模下降。

ChatGP與InstructGPT

ChatGPT與InstructGPT

談到Chatgpt,就要聊聊它的“前身”InstructGPT。

2022年初,OpenAI發布了InstructGPT;在這項研究中,相比GPT-3而言,OpenAI采用對齊研究,訓練出更真實、更無害,而且更好地遵循用戶意圖的語言模型InstructGPT,InstructGPT是一個經過微調的新版本GPT-3,可以將有害的、不真實的和有偏差的輸出最小化。

InstructGPT的工作原理是什么?

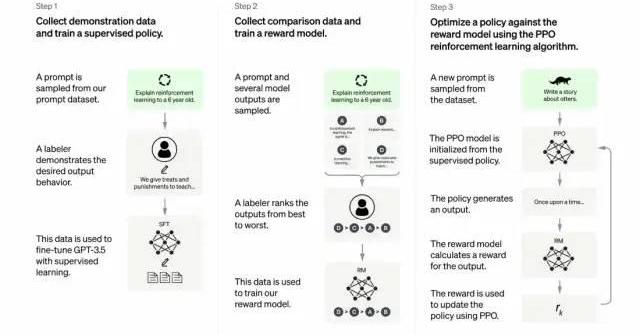

開發人員通過結合監督學習+從人類反饋中獲得的強化學習。來提高GPT-3的輸出質量。在這種學習中,人類對模型的潛在輸出進行排序;強化學習算法則對產生類似于高級輸出材料的模型進行獎勵。

訓練數據集以創建提示開始,其中一些提示是基于GPT-3用戶的輸入,比如“給我講一個關于青蛙的故事”或“用幾句話給一個6歲的孩子解釋一下登月”。

開發人員將提示分為三個部分,并以不同的方式為每個部分創建響應:

人類作家會對第一組提示做出響應。開發人員微調了一個經過訓練的GPT-3,將它變成InstructGPT以生成每個提示的現有響應。

下一步是訓練一個模型,使其對更好的響應做出更高的獎勵。對于第二組提示,經過優化的模型會生成多個響應。人工評分者會對每個回復進行排名。在給出一個提示和兩個響應后,一個獎勵模型(另一個預先訓練的GPT-3)學會了為評分高的響應計算更高的獎勵,為評分低的回答計算更低的獎勵。

開發人員使用第三組提示和強化學習方法近端策略優化(ProximalPolicyOptimization,PPO)進一步微調了語言模型。給出提示后,語言模型會生成響應,而獎勵模型會給予相應獎勵。PPO使用獎勵來更新語言模型。

本段參考:TheBatch:329|InstructGPT,一種更友善、更溫和的語言模型-公眾號DeeplearningAI-2022-02-0712:30

重要在何處?核心在于——人工智能需要是能夠負責任的人工智能

OpenAI的語言模型可以助力教育領域、虛擬治療師、寫作輔助工具、角色扮演游戲等,在這些領域,社會偏見、錯誤信息和害信息存在都是比較麻煩的,能夠避免這些缺陷的系統才能更具備有用性。

Chatgpt與InstructGPT的訓練過程有哪些不同?

總體來說,Chatgpt和上文的InstructGPT一樣,是使用RLHF訓練的。不同之處在于數據是如何設置用于訓練的。

ChatGPT存在哪些局限性?

如下:a)在訓練的強化學習(RL)階段,沒有真相和問題標準答案的具體來源,來答復你的問題。b)訓練模型更加謹慎,可能會拒絕回答。c)監督訓練可能會誤導/偏向模型傾向于知道理想的答案,而不是模型生成一組隨機的響應并且只有人類評論者選擇好的/排名靠前的響應

注意:ChatGPT對措辭敏感。,有時模型最終對一個短語沒有反應,但對問題/短語稍作調整,它最終會正確回答。訓練者更傾向于喜歡更長的答案,因為這些答案可能看起來更全面,導致傾向于更為冗長的回答,以及模型中會過度使用某些短語,如果初始提示或問題含糊不清,則模型不會適當地要求澄清。

Tags:GPTTRUCNSTUCTbgpt幣最新消息RSK Infrastructure Frameworkonston幣價格EOS Auction

Part.1Insight本文將主要討論ZKP作為擴容方案的發展現狀,從理論層面描述產生證明過程中主要需要優化的幾個維度,并引深到不同擴容方案對于加速的需求.

1900/1/1 0:00:00簡介 11月13日,ElonMusk為Twitter進行了1000多次RPC來呈現用戶的主頁時間線而道歉。乍一看,如此大量的RPC似乎很荒謬.

1900/1/1 0:00:00在Web2時代,流媒體出現的早期,很多音樂人認為,自己正在迎來一個自由競爭的音樂烏托邦時代——在流媒體的世界中,所有的創作者都有機會被聽到,曾經小眾的聲音將擁有被大眾認知的機會.

1900/1/1 0:00:00背景 Opensea為什么要推出版稅新政?這需要我們去回顧下過去幾個月發生的一些行業事件。8月26號,X2Y2在官方推特上聲明了一項功能,即版稅可以由買家進行選擇,選項包括0%,25%,50%,

1900/1/1 0:00:00隨著FTX事件的波瀾逐漸褪去,加密行業的注意力重新回到了發展與建設中來。過去一個月市場的接連暴雷,動搖了許多從業者的目標和信心,過去在大家心中的「絕對權威」都倒下了,還有誰愿意支持Web3的發展.

1900/1/1 0:00:00FTX及其創始人的崩潰是歷史上最引人注目的內爆事件之一。Tether,應該是這樣的:USDT,或Tether,是所謂的“穩定幣”。穩定幣是一種加密貨幣,它的價值不是波動的,而是要保持穩定的價格.

1900/1/1 0:00:00