BTC/HKD-0.03%

BTC/HKD-0.03% ETH/HKD-0.73%

ETH/HKD-0.73% LTC/HKD+0.05%

LTC/HKD+0.05% ADA/HKD-0.92%

ADA/HKD-0.92% SOL/HKD-1.34%

SOL/HKD-1.34% XRP/HKD-0.53%

XRP/HKD-0.53%來源:新智元編輯:Aeneas好困

快速定制模型的LLM引擎Lamini來了,開發者狂喜!

ChatGPT雖好,但始終有門檻。通常,只有擁有AI博士學位的大型機器學習團隊,才能這樣訓練一個模型。

為了把這個門檻打下來,團隊構建了Lamini引擎,從此,每個開發者都能夠擁有從GPT-3訓練ChatGPT的超能力!

劃重點:可以商用!可以商用!可以商用!

項目地址:https://github.com/lamini-ai/lamini/

Lamini的開發團隊表示,你需要的只是幾行代碼,就可以用托管數據生成器倆訓練自己的LLM,包括權重和其他所有的內容。

此外,你也可以使用開源的LLM,用Lamini庫對生成的數據進行微調。以及訪問完整的LLM訓練模塊,使用從LoRa等速度優化,到虛擬私有云(VPC)部署等企業功能。

對此,英偉達科學家JimFan表示,LLaMa+自定義數據正在成為新的范式,而Lamini的推出也帶了一種全新的模式——FaaS,微調即服務。

Kava 14主網現已上線:7月13日消息,Kava發推稱,Kava 14主網現已上線。[2023/7/13 10:51:41]

MLOps的未來是「LMOps」。哪里有標準化,哪里就有機會。

OpenAI科學家,前特斯拉人工智能總監AndrejKarpathy也表示,LLM定制化的生態正在愈發火爆。

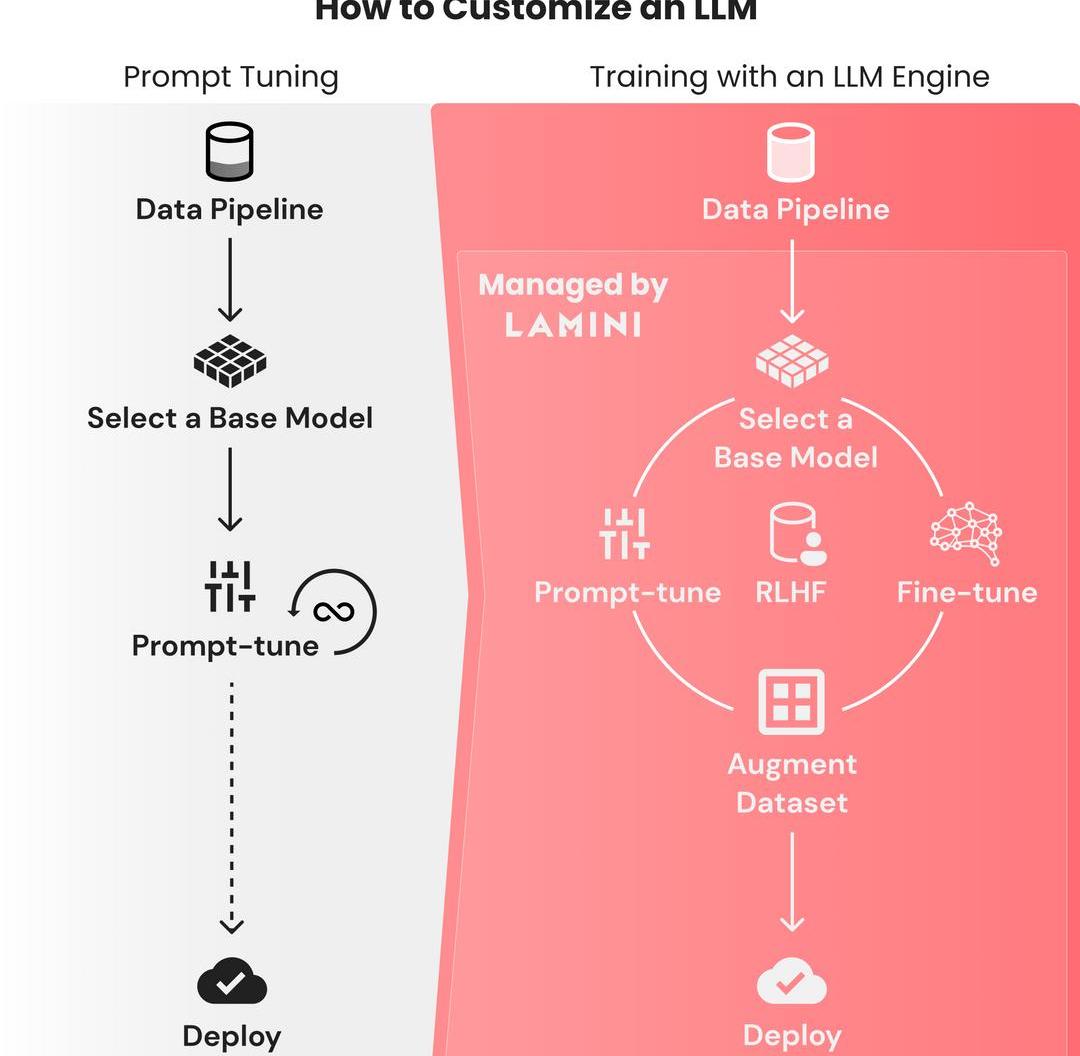

訓LLM就像prompt-tuning一樣簡單

寫一個prompt如此容易,但想要從基礎模型訓練出一個大語言模型,卻是如此困難。

因為需要花費大量時間,來找出微調模型失敗的原因,所以對數據集微調的迭代周期都是以月為單位的。

與之相反,微調prompt的迭代,只需要幾秒鐘,并且在幾個小時內,性能都能保持穩定。

這個過程只需要把有限數量的數據整合到prompt中就可以了,并不需要動輒幾TB的數據。

ChatGPT的誕生十分艱難,OpenAI的團隊花了幾個月的時間,在基礎的GPT-3模型上微調,并進行RLHF。這個門檻極高,只有大型的ML團隊才能完成這種訓練。

有500強企業的技術負責人這樣抱怨過:「我們團隊的10名機器學習工程師用了OpenAI的微調API,結果我們的模型反而變得更差了,怎么辦啊。」

歐盟關于數字歐元的立法被擱置:金色財經報道,原定于6月28日公布的歐盟立法需要支持數字歐元,但已被擱置。此舉是在法案草案泄露之后發生的,該草案涵蓋了中央銀行數字貨幣(CBDC)的隱私和技術問題,以及財政部長上周發表的一份聲明似乎質疑該計劃的動機。

該法案草案的時間表原定于歐洲央行就是否以數字形式發行貨幣做出堅定決定之前公布,但該草案的時間表已經發生了數次變化。它處于計劃于5月進行的一個階段。根據上周公布的暫定前瞻議程,該法案最近計劃在歐盟委員會決策機構6月28日的會議上進行討論和公布。該委員會沒有提供延遲的原因,也沒有給出新的發布日期。[2023/6/20 21:48:08]

「我真的不知道該怎么充分利用數據,我已經用盡了所有從在線教程中能學到的prompt魔法了。」

這,就是研究者構建Lamini的原因:讓每個開發者可以直接從GPT-3訓練ChatGPT。

任意LLM,秒變ChatGPT!

Lamini是一個LLM引擎,可以讓不僅僅是機器學習專家的任何開發人員,都能在大型數據集中,把高性能的LLM訓練得像ChatGPT一樣好。

這個過程,只需要Laimini庫的幾行代碼即可。

值得注意的是,這個庫中的優化遠遠超出了現在開發者可以使用的范圍,從更具挑戰性的優化到更簡單的優化。

比如,你想從不同的角度生成一個廣告文案。

首先,從llama模塊導入LLM引擎:

fromllamaimportLLMllm=LLM(name="marketing")

接下來,需要定義輸入和輸出類型。注意,這里一定要包括上下文,因為可以有助于LLM在自然語言中進行理解。

幣安與Kuna已暫停烏克蘭格里夫納行匯率的銀行卡業務:金色財經報道,加密貨幣交易所幣安與烏克蘭交易所Kuna宣布暫停使用烏克蘭格里夫納匯率的銀行卡業務。幣安發言人表示,烏克蘭國家銀行 (NBU) 施加的限制導致本國貨幣的存款和取款處理受限,已建議交易者使用其點對點市場。[2023/3/5 12:43:16]

fromllamaimportType,ContextclassAdAspects(Type):tone:str=Context("toneofthemarketingcopy")product_features:list=Context("productfeaturestopromote")audience:str=Context("targetaudienceforthemessage")subject:str=Context("subjectortopicofthemessage")goal:str=Context("goalofthismarketingcampaignandmessage")classAdCopy(Type):title:str=Context("googleadtitletag")description:str=Context("googleaddescription")keywords:list=Context("keywordsforthesearchengine")

然后就可以開始提問了:

語氣:大膽,但不傲慢

特色:亞洲醬料和香料、家常調料和套餐包,可以輕松在家烹飪。

aspects=AdAspects(tone="boldandbright,butnotarrogant",product_features=,audience="suburbanfamilies",subject="deliciousasianmealswithoutgoingtoarestaurant",goal="getsuburbanmomsanddadstotrybuytheirfirstomsompackorfreetastingkit")ad_copy=llm(input=aspects,output_type=AdCopy)print(f"Adcopy:{ad_copy}")模型輸出:

時尚品牌Scotch&Soda推出基于NFT的客戶忠誠度計劃“Club Soda3.0”:9月20日消息,時尚品牌Scotch&Soda宣布推出支持NFT的忠誠度俱樂部計劃“Club Soda3.0”并將在Polygon區塊鏈上鑄造1,000枚Founder's Pass NFT。NFT持有者將會獲得Scotch&Soda獨家體驗、活動和優惠等福利。(Theindustry.fashion)[2022/9/21 7:09:24]

嘗試Omsom的美味亞洲醬料、香料、家常調料和套餐包。輕松為家人在家做出美味佳肴。

>title='DeliciousAsianMealsWithoutGoingtoaRestaurant|Omsom'description="TryOmsom'sdeliciousAsiansauces,aromatics,andhome-cookedseasoningsandmealpacks.Easilycookdeliciousmealsathomeforyourfamily."keywords=

如何創建自己的「ChatGPT」

基礎模型能理解一般的英語,但如果需要它們學習一些垂直語言和規則,prompt微調并不足夠,很多時候我們都需要構建自己的LLM。

利用用下面這個步驟,就能獲得像ChatGPT一樣遵循指令的LLM。

嘗試prompt-tuningChatGPT或其他模型

巴西金融科技公司Nu Holdings二季度新增客戶達570萬名:金色財經報道,巴西數字銀行Nubank的母公司、巴西金融科技公司Nu Holdings在第二季度增加了570萬客戶,使用其服務的個人和企業數量達到6530萬。Nu在7月涉足加密貨幣領域,其Nucripto平臺推出后三周內就增加了100萬客戶,Nu Holdings在巴西擁有最大的業務,但第二季度在墨西哥和哥倫比亞增加了近700,000名客戶。

此外,Nu Holdings第二季度的凈虧損增至2990萬美元,而2021年同期為1520萬美元。該公司在收益中表示,這是由于“本季度更高的股票薪酬和相關稅收影響”。[2022/8/16 12:27:31]

可以使用Lamini庫的API,在不同模型之間快速進行prompt-tuning,只需一行代碼,即可在OpenAI和開源模型之間切換。

Lamini庫已經優化了正確的prompt,這樣開發者就可以使用不同的模型,不必擔心如何為每個模型設置prompt的格式。

構建一個包含輸入-輸出對的大型數據集

這些數據集會向模型展示,它應該如何響應輸入,無論是遵循英文說明,還是以JSON響應。

研究者剛剛發布了一個只有幾行代碼的repo,使用Lamini庫,僅從100個數據點中,就能生成50k數據點。

而且因為使用Lamini庫來啟動Lamini引擎,所以這個過程根本不需要用到GPU。

在repo中,已經包含一個開源的70+k數據集。

項目地址:https://github.com/lamini-ai/lamini/

在大型數據集上微調基礎模型

除了數據生成器,研究者還發布了一個LLM,它使用Lamini對生成的數據進行了微調。以編程方式執行此操作的功能也會很快發布。

也可以把OpenAI的微調API作為起步。

在微調模型上進行RLHF

使用Lamini,就不再需要大型ML和人工標記團隊來運行RLHF。

部署到云端

只需點擊產品或功能中的API端點即可。

專為LLM打造的數據生成器

簡單來說,依照以下幾個步驟,就可以訓練自己的大語言模型了。

用于優化prompt微調和類型化輸出的Lamini庫。

用于微調和RLHF的高級Lamini庫,只需幾行代碼。

史上首個托管數據生成器,用于創建數據,來訓練遵循指令的LLM。注意,已獲得商業使用許可!

開源的指令跟隨LLM,使用上述工具,只需幾行代碼即可完成。

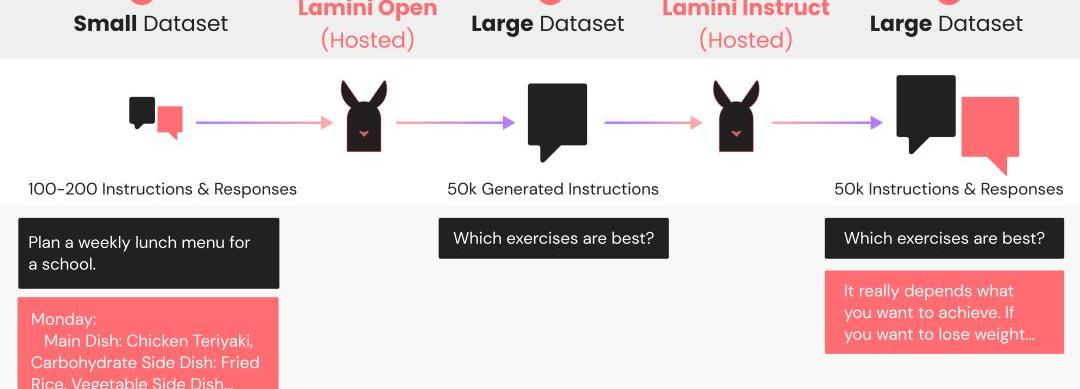

數據生成器工作原理

Lamini數據生成器是一個LLM管線,它采用原始的100多條指令的小集合,與預期的響應配對,生成50k+新的配對,靈感來自Stanford的Alpaca。這個生成管線使用Lamini庫來定義和調用LLM,以生成不同但相似的指令和響應對。

根據這些數據訓練后,你的LLM會遵循這些指示,因而得到改進。對于使用開源LLM的生成管線,研究者提供了一個很好的默認值,LaminiOpen和LaminiInstruct。

隨著每天新的LLM發布,研究者都會將默認值更新為性能最佳的模型。在目前的版本中,LaminiOpen用的是EleutherAI的Pythia,LaminiInstruct用的是Databricks的Dolly。

LaminiOpen會生成更多指令,而LaminiInstruct會生成這些指令的成對響應。

最終生成的數據集可供免費商業使用,已經通過CC-BY許可。

僅用一行代碼,就可以將Lamini庫的默認值換成其他開源或OpenAI模型。

研究者發現,OpenAI模型的平均表現更好,但它們的許可限制了將生成數據用于訓練類ChatGPT模型的商用。

對生成數據進行微調

在這個過程中,生成的數據會質量不一。

在微調之前,下一步就是將生成的數據過濾為高質量數據。

然后,Lamini會通過在這個過濾后生成的數據集上訓練基礎模型,來創建自定義LLM。

研究者已經發布了一個開源指令跟隨LLM,可以用Lamini來訓練Pythia基礎模型,生成的37k指令是從70k中篩選出來的。

顯然,Lamini庫的出現,讓迭代周期變得更快、更有效,有更多的人能夠構建模型,而不僅僅是試驗各種prompt。

團隊介紹

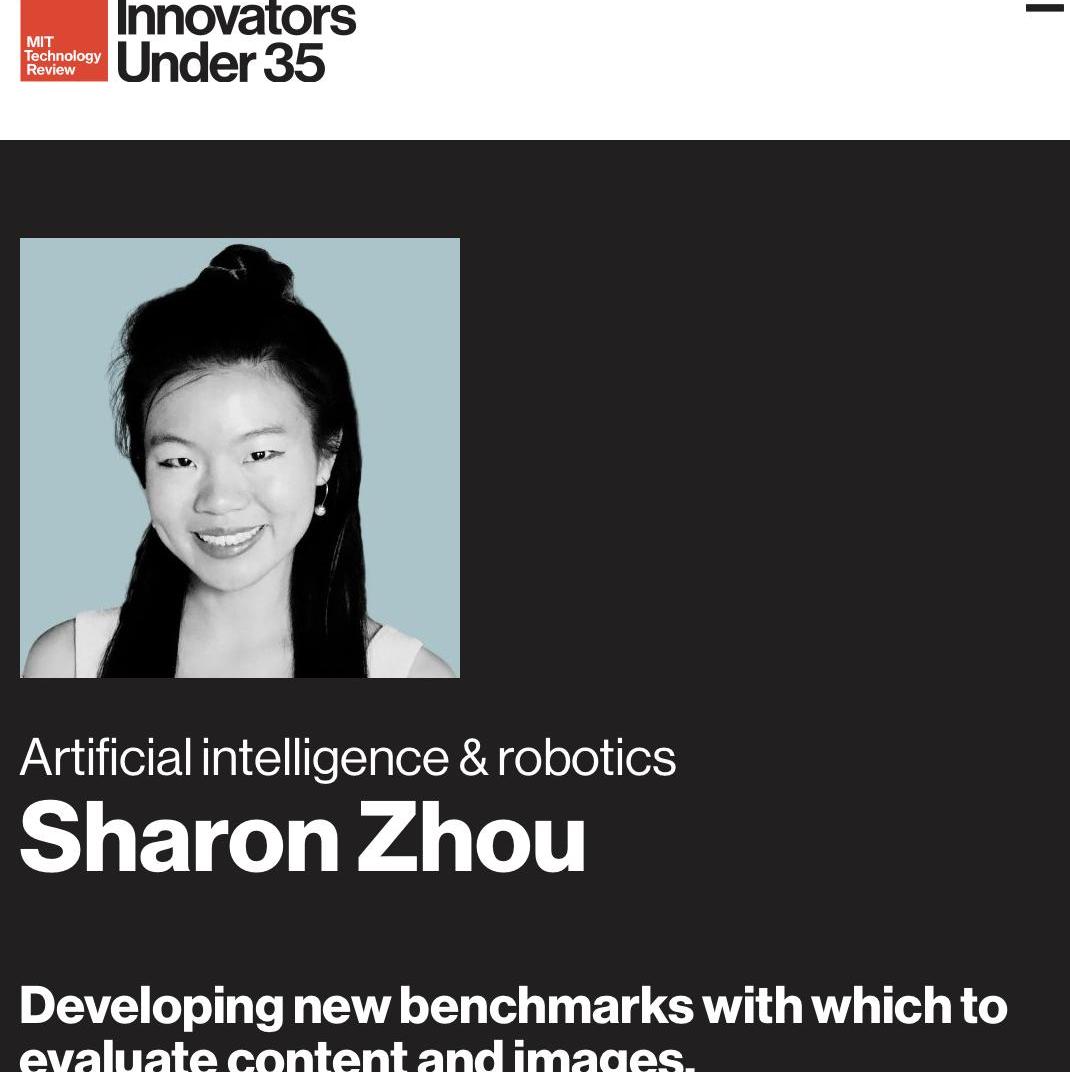

SharonZhou是Lamini的聯合創始人兼首席執行官。

個人主頁:https://sharonzhou.me/

她在哈佛大學獲得了計算機科學與古典文學聯合學士學位,并以最高榮譽獲得了碩士學位。

隨后,她在斯坦福大學獲得了計算機科學博士學位,師從吳恩達。

2022年,29歲的Zhou入選《麻省理工科技評論》「35歲以下科技創新35人」。

GregoryDiamos是MLPerf的聯合創始人。

他曾是百度硅谷AI實驗室的創始成員,對DeepSpeech和DeepVoice系統有貢獻。

參考資料:

https://lamini.ai/blog/introducing-lamini

Tags:MINMINIPROROMYield Farming XL郭家毅gemini女朋友是哪里人Ducato Protocol TokenRomeo Doge

4月,以太坊上海升級與香港Web3動向成最大熱點,上海升級的完成是轉POS的重要里程碑,從市場而言,由于升級解鎖質押ETH是否引發拋壓備受關注,僅以交易表現來看,并未出現大范圍的拋壓與離場.

1900/1/1 0:00:00最近幾個月來,比特幣生態最大的事件就是比特幣Ordinals協議和銘文的爆發。銘文提供了一種將信息附加到比特幣交易中的新方式。用戶可以充分利用比特幣的去中心化、安全等特性.

1900/1/1 0:00:00比特幣自誕生以來就被譽為一種革命性的技術,有可能改變我們使用新金融層進行交易的方式。最近,出現了一項新的創新,可以為比特幣網絡開啟新的可能性,使其也可以作為文化層發揮作用.

1900/1/1 0:00:00就在昨天,央視《焦點訪談》報道了凱盛融英“淪為境外情報機構幫兇”的消息。據稱,凱盛融英介紹的行業專家,違規向境外機構客戶提供了涉密信息,涉嫌危害國家安全.

1900/1/1 0:00:00原文作者:Zeneca,加密研究員最近的幣圈,除了meme還是meme,玩NFT的賣猴子去買PEPE、擼毛的用Gas、炒幣的賣主流幣去買PEPE,目前來看,meme狂潮還是不會短時間平息.

1900/1/1 0:00:00金色財經報道,灰度在其官網上發文談BTCOrdinals,文章稱,Ordinals有效地在比特幣網絡上創建了一個NFT,雖然有些人批評Ordinals,警告不要讓區塊鏈膨脹或損害可替代性.

1900/1/1 0:00:00