BTC/HKD-0.85%

BTC/HKD-0.85% ETH/HKD-2.75%

ETH/HKD-2.75% LTC/HKD-2.52%

LTC/HKD-2.52% ADA/HKD-1.9%

ADA/HKD-1.9% SOL/HKD-3.07%

SOL/HKD-3.07% XRP/HKD-3.75%

XRP/HKD-3.75%“Theonlysimpletruthisthatthereisnothingsimpleinthiscomplexuniverse.Everythingrelates.Everythingconnects”

—JohnnyRich,TheHumanScript

介紹

機器學習的主要應用之一是對隨機過程建模。機器學習中一些隨機過程的例子如下:

泊松過程:用于處理等待時間以及隊列。隨機漫步和布朗運動過程:用于交易算法。馬爾可夫決策過程:常用于計算生物學和強化學習。高斯過程:用于回歸和優化問題(如,超參數調優和自動機器學習)。自回歸和移動平均過程:用于時間序列分析(如,ARIMA模型)。在本文中,我將簡要地向你介紹這些隨機過程。

歷史背景

隨機過程是我們日常生活的一部分。隨機過程之所以如此特殊,是因為隨機過程依賴于模型的初始條件。在上個世紀,許多數學家,如龐加萊,洛倫茲和圖靈都被這個話題所吸引。

如今,這種行為被稱為確定性混沌,它與真正的隨機性有著截然不同的范圍界限。

由于愛德華·諾頓·洛倫茲的貢獻,混沌系統的研究在1963年取得了突破性進展。當時,洛倫茲正在研究如何改進天氣預報。洛倫茲在他的分析中注意到,即使是大氣中的微小擾動也能引起氣候變化。

洛倫茲用來描述這種狀態的一個著名的短語是:

“AbutterflyflappingitswingsinBrazilcanproduceatornadoinTexas”(在巴西,一只蝴蝶扇動翅膀就能在德克薩斯州制造龍卷風)—EdwardNortonLorenz(愛德華·諾頓·洛倫茲)

這就是為什么今天的混沌理論有時被稱為“蝴蝶效應”。

分形學

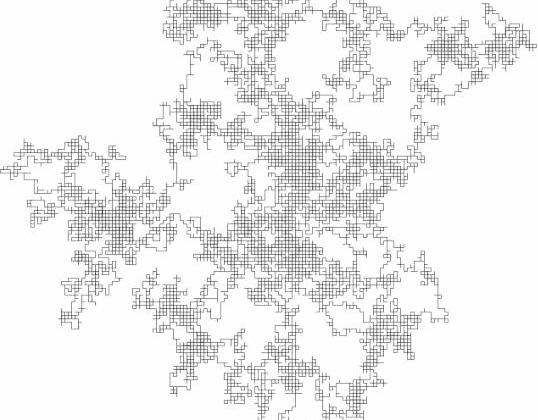

一個簡單的混沌系統的例子是分形(如圖所示)。分形是在不同尺度上不斷重復的一種模式。由于分形的縮放方式,分形不同于其他類型的幾何圖形。分形是遞歸驅動系統,能夠捕獲混沌行為。在現實生活中,分形的例子有:樹、河、云、貝殼等。

鏈上隨機生成NFT項目Owls24小時交易額超500萬美元:3月5日消息,據NFTGo.io數據顯示,FreeMint的鏈上隨機生成NFT項目Owls24小時交易額達503萬美元,截止發稿該系列NFT地板價暫報0.37ETH。Owls總量9999枚,每枚Owls都是在Mint時使用偽隨機種子在鏈上隨機生成的。NFT Metadata本身也存儲在鏈上,并在每次調用token URI()時動態構建為SVG。[2023/3/5 12:43:17]

圖1:MC.Escher,SmallerandSmaller

在藝術領域有很多自相似的圖形。毫無疑問,MC.Escher是最著名的藝術家之一,他的作品靈感來自數學。事實上,在他的畫中反復出現各種不可能的物體,如彭羅斯三角形和莫比烏斯帶。在"SmallerandSmaller"中,他也反復使用了自相似性(圖1)。除了蜥蜴的外環,畫中的內部圖案也是自相似性的。每重復一次,它就包含一個有一半尺度的復制圖案。

確定性和隨機性過程

有兩種主要的隨機過程:確定性和隨機性。

在確定性過程中,如果我們知道一系列事件的初始條件(起始點),我們就可以預測該序列的下一步。相反,在隨機過程中,如果我們知道初始條件,我們不能完全確定接下來的步驟是什么。這是因為這個過程可能會以許多不同的方式演化。

在確定性過程中,所有后續步驟的概率都為1。另一方面,隨機性隨機過程的情況則不然。

任何完全隨機的東西對我們都沒有任何用處,除非我們能識別出其中的模式。在隨機過程中,每個單獨的事件都是隨機的,盡管可以識別出連接這些事件的隱藏模式。這樣,我們的隨機過程就被揭開了神秘的面紗,我們就能夠對未來的事件做出準確的預測。

比特幣礦工今年挖掘的空區塊數量減少,或為隨機事件:金色財經報道,截止2020年的前五個月,比特幣礦工共挖掘了71個空區塊,占挖掘出的區塊總量的0.3%,不到去年同期0.79%的一半。一些礦池表示,他們沒有針對挖掘空區塊的特定策略,因此空區塊的減少可能是隨機事件。[2020/6/16]

為了用統計學的術語來描述隨機過程,我們可以給出以下定義:

觀測值:一次試驗的結果。總體:所有可能的觀測值,可以記為一個試驗。樣本:從獨立試驗中收集的一組結果。例如,拋一枚均勻硬幣是一個隨機過程,但由于大數定律,我們知道,如果進行大量的試驗,我們將得到大約相同數量的正面和反面。

大數定律指出:

“隨著樣本規模的增大,樣本的均值將更接近總體的均值或期望值。因此,當樣本容量趨于無窮時,樣本均值收斂于總體均值。重要的一點是樣本中的觀測必須是相互獨立的。”--JasonBrownlee

隨機過程的例子有股票市場和醫學數據,如血壓和腦電圖分析。

泊松過程

泊松過程用于對一系列離散事件建模,在這些事件中,我們知道不同事件發生的平均時間,但我們不知道這些事件確切在何時發生。

如果一個隨機過程能夠滿足以下條件,則可以認為它屬于泊松過程:

事件彼此獨立(如果一個事件發生,并不會影響另一個事件發生的概率)。兩個事件不能同時發生。事件的平均發生比率是恒定的。讓我們以停電為例。電力供應商可能會宣傳平均每10個月就會斷電一次,但我們不能準確地說出下一次斷電的時間。例如,如果發生了嚴重問題,可能會連續停電2-3天(如,讓公司需要對電源供應做一些調整),以便在接下來的兩天繼續使用。

因此,對于這種類型的隨機過程,我們可以相當確定事件之間的平均時間,但它們是在隨機的間隔時間內發生的。

由泊松過程,我們可以得到一個泊松分布,它可以用來推導出不同事件發生之間的等待時間的概率,或者一個時間段內可能發生事件的數量。

BM解答EOS區塊鏈中隨機數的問題:據金色財經合作媒體IMEOS報道:今天,BM在EOS開發者群回答了EOS區塊鏈的安全性問題,因為有人對基于生成隨機數的智能合約是否安全可靠,節點是否容易作弊提出了質疑。他回答道,保證安全性最簡單的方法是讓參與雙方共同承擔責任。如果用戶信任區塊生產者,那么他就可以獲取區塊生產者在記錄交易的特定時機獲取某些信息的哈希值,這些哈希值將作為“隨機數”以確保安全性。[2018/4/25]

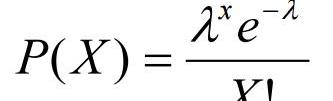

泊松分布可以使用下面的公式來建模(圖2),其中k表示一個時期內可能發生的事件的預期數量。

圖2:泊松分布公式

一些可以使用泊松過程模擬的現象的例子是原子的放射性衰變和股票市場分析。

隨機漫步和布朗運動過程

隨機漫步是可以在隨機方向上移動的任意離散步的序列(長度總是相同)(圖3)。隨機漫步可以發生在任何維度空間中(如:1D,2D,nD)。

圖3:高維空間中的隨機漫步

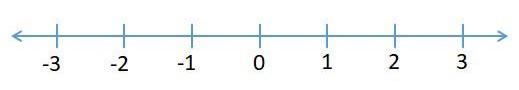

現在我將用一維空間(數軸)向您介紹隨機漫步,這里解釋的這些概念也適用于更高維度。

我們假設我們在一個公園里,我們看到一只狗在尋找食物。它目前在數軸上的位置為0,它向左或向右移動找到食物的概率相等(圖4)。

圖4:數軸

現在,如果我們想知道在N步之后狗的位置是多少,我們可以再次利用大數定律。利用這個定律,我們會發現當N趨于無窮時,我們的狗可能會回到它的起點。無論如何,此時這種情況并沒有多大用處。

EOS將在6月啟動創世節點,并不是隨機挑選候選節點,而是挑出技術能力強的:據金色財經合作媒體IMEOS整理報道:EOS團隊成員Thomas在EOS一周Q&A中表示針對6月啟動創世節點的問題中點名表揚由EOS GO、IMEOS和KOREOS對候選節點分組測試所做的努力。EOS將在6月啟動創世節點,并不是隨機挑選候選節點,而是會征求各個候選節點的意見,挑出技術能力強的。同時表示EOS目前的主要精力在于把6月份要上線的版本做好。而且將會對EOS進行至少10年的長期投入,目前EOS共持有1億代幣,這些代幣需要10年解鎖。[2018/4/25]

因此,我們可以嘗試使用均方根(RMS)作為距離度量(首先對所有值求平方,然后計算它們的平均值,最后對結果求平方根)。這樣,所有的負數都變成正數,平均值不再等于零。

在這個例子中,使用RMS我們會發現,如果我們的狗走了100步,它平均會從原點移動10步(√100=10)。

如前面所述,隨機漫步用于描述離散時間過程。相反,布朗運動可以用來描述連續時間的隨機漫步。

隱馬爾科夫模型

隱馬爾可夫模型都是關于認識序列信號的。它們在數據科學領域有大量應用,例如:

計算生物學。寫作/語音識別。自然語言處理(NLP)。強化學習HMMs是一種概率圖形模型,用于從一組可觀察狀態預測隱藏(未知)狀態序列。

這類模型遵循馬爾可夫過程假設:

“鑒于我們知道現在,所以未來是獨立于過去的"

因此,在處理隱馬爾可夫模型時,我們只需要知道我們的當前狀態,以便預測下一個狀態(我們不需要任何關于前一個狀態的信息)。

要使用HMMs進行預測,我們只需要計算隱藏狀態的聯合概率,然后選擇產生最高概率(最有可能發生)的序列。

為了計算聯合概率,我們需要以下三種信息:

Zcash開發人員利用切爾諾貝利核電站的核廢料來產生隨機數 :Zcash的開發人員在該網絡最新的秘密保證儀式中使用了切爾諾貝利核電站的核廢料。上個周末,Zcash的兩位開發人員舉行了他們最新的“Tau”儀式,并特別使用核廢料來產生隨機數。Andrew Miller表示,Tau的力量完全在于生成和安全地處理加密的“有廢物”,從理論上講,其結果是一個完全隨機的、私有的代碼,可以用來構建Zcash。[2018/1/28]

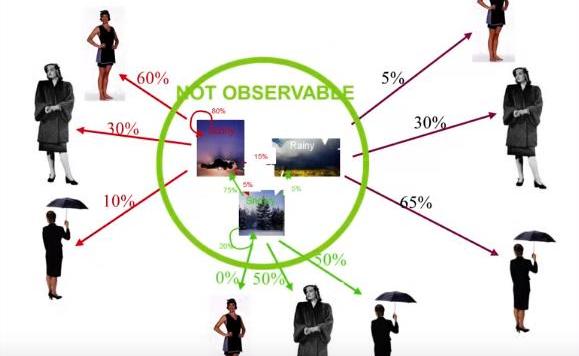

初始狀態:任意一個隱藏狀態下開始序列的初始概率。轉移概率:從一個隱藏狀態轉移到另一個隱藏狀態的概率。發射概率:從隱藏狀態移動到觀測狀態的概率舉個簡單的例子,假設我們正試圖根據一群人的穿著來預測明天的天氣是什么(圖5)。

在這種例子中,不同類型的天氣將成為我們的隱藏狀態。晴天,刮風和下雨)和穿的衣服類型將是我們可以觀察到的狀態(如,t恤,長褲和夾克)。初始狀態是這個序列的起點。轉換概率,表示的是從一種天氣轉換到另一種天氣的可能性。最后,發射概率是根據前一天的天氣,某人穿某件衣服的概率。

圖5:隱馬爾可夫模型示例

使用隱馬爾可夫模型的一個主要問題是,隨著狀態數的增加,概率和可能狀態的數量呈指數增長。為了解決這個問題,可以使用維特比算法。

如果您對使用HMMs和生物學中的Viterbi算法的實際代碼示例感興趣,可以在我的Github代碼庫中找到它。

從機器學習的角度來看,觀察值組成了我們的訓練數據,隱藏狀態的數量組成了我們要調優的超參數。

機器學習中HMMs最常見的應用之一是agent-based情景,如強化學習(圖6)。

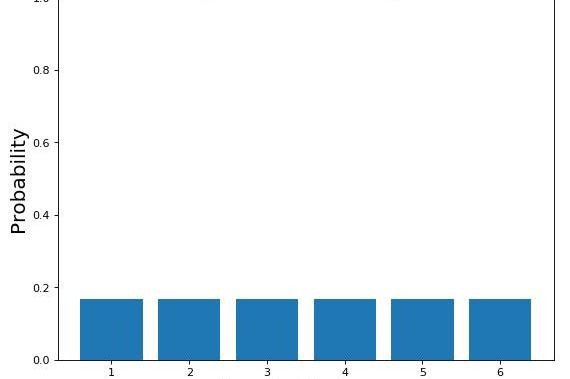

圖7:擲骰子公平的概率分布

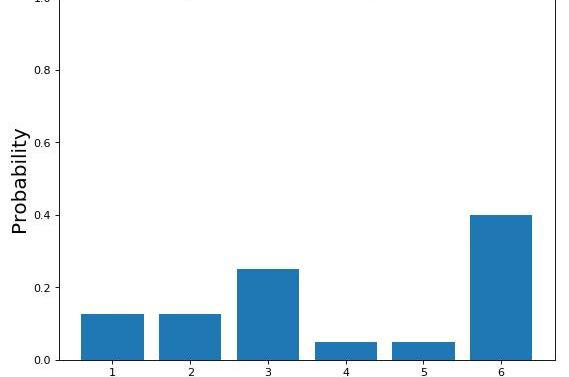

無論如何,你玩得越多,你就越可以看到到骰子總是落在相同的面上。此時,您開始考慮骰子可能是不公平的,因此您改變了關于概率分布的最初信念(圖8)。

圖8:不公平骰子的概率分布

這個過程被稱為貝葉斯推理。

貝葉斯推理是我們在獲得新證據的基礎上更新自己對世界的認知的過程。

我們從一個先前的信念開始,一旦我們用全新的信息更新它,我們就構建了一個后驗信念。這種推理同樣適用于離散分布和連續分布。

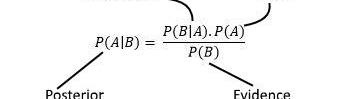

因此,高斯過程允許我們描述概率分布,一旦我們收集到新的訓練數據,我們就可以使用貝葉斯法則(圖9)更新分布。

圖9:貝葉斯法則

自回歸移動平均過程

自回歸移動平均(ARMA)過程是一類非常重要的分析時間序列的隨機過程。ARMA模型的特點是它們的自協方差函數只依賴于有限數量的未知參數(對于高斯過程是不可能的)。

縮略詞ARMA可以分為兩個主要部分:

自回歸=模型利用了預先定義的滯后觀測值與當前滯后觀測值之間的聯系。移動平均=模型利用了殘差與觀測值之間的關系。ARMA模型利用兩個主要參數(p,q),分別為:

p=滯后觀測次數。q=移動平均窗口的大小。ARMA過程假設一個時間序列在一個常數均值附近均勻波動。如果我們試圖分析一個不遵循這種模式的時間序列,那么這個序列將需要被差分,直到分割后的序列具有平穩性。

這可以通過使用一個ARIMA模型來實現,如果你有興趣了解更多,我寫了一篇關于使用ARIMA進行股票市場分析的文章。

謝謝閱讀!

參考文獻

MCEscher,“SmallerandSmaller”—1956.訪問:https://www.etsy.com/listing/288848445/m-c-escher-print-escher-art-smaller-and

機器學習中大數定律的簡要介紹。MachineLearningMastery,JasonBrownlee.訪問:https://machinelearningmastery.com/a-gentle-introduction-to-the-law-of-large-numbers-in-machine-learning/

正態分布,二項分布,泊松分布,MakeMeAnalyst.訪問:http://makemeanalyst.com/wp-content/uploads/2017/05/Poisson-Distribution-Formula.png

通用維基百科.Accessedat:https://commons.wikimedia.org/wiki/File:Random_walk_25000.gif

數軸是什么?MathematicsMonste.訪問:https://www.mathematics-monster.com/lessons/number_line.html

機器學習算法:SD(σ)-貝葉斯算法.SagiShaier,Medium.訪問:https://towardsdatascience.com/ml-algorithms-one-sd-%CF%83-bayesian-algorithms-b59785da792a

DeepMind的人工智能正在自學跑酷,結果非常令人驚訝。TheVerge,JamesVincent.訪問:https://www.theverge.com/tldr/2017/7/10/15946542/deepmind-parkour-agent-reinforcement-learning

為數據科學專業人員寫的強大的貝葉斯定理介紹。KHYATIMAHENDRU,AnalyticsVidhya.Accessedat:https://www.analyticsvidhya.com/blog/2019/06/introduction-powerful-bayes-theorem-data-science/

viahttps://towardsdatascience.com/stochastic-processes-analysis-f0a116999e4

今日資源推薦:AI入門、大數據、機器學習免費教程

35本世界頂級原本教程限時開放,這類書單由知名數據科學網站KDnuggets的副主編,同時也是資深的數據科學家、深度學習技術愛好者的MatthewMayo推薦,他在機器學習和數據科學領域具有豐富的科研和從業經驗。

點擊鏈接即可獲取:https://ai.yanxishe.com/page/resourceDetail/417

雷鋒網雷鋒網雷鋒網

教育,一直都是中英合作的重要領域。近幾年,英國私校品牌在中國市場可謂是“豐收年”。本周多所英國私校品牌落戶中國......◎國王伍德公學落戶義烏2021年9月開學◎博實樂投資20億元打造廣州斐特.

1900/1/1 0:00:00一說起這種文化,想必很多人都對此有些了解,這個文化反映了我國古代上層社會的一種閑情雅致,同時也反映了我國當時人們對寵物的一種寄托.

1900/1/1 0:00:00近日,Facebook注冊在瑞士的子公司LibraNetwork(天秤座網絡)發布了堪稱“大殺器”的Libra(天秤幣)白皮書,其內容與坊間猜測高度一致.

1900/1/1 0:00:00最近吉克雋逸作為美妝博主跟我們分享了一波高光盤,從Becca到Kylie都是我想要的網紅款! 不僅是臉上,全身涂高光是日常操作,只要露肉的地方統統都在發光.

1900/1/1 0:00:00現在手機支付非常方便,但生活中還是有很多地方會用到現金。比如做小生意的,會收到很多零鈔和硬幣。如果收到大量零錢,要到銀行里換整錢或存錢,是怎樣一個手續呢?大家都知道,整張的100元和50元可以在.

1900/1/1 0:00:00比特幣是一種數字貨幣,直到2140年達到2100萬個的總量上限,目前被挖出的比特幣總量已經超過1700萬個,還有不到4000萬個散落在世界各個角落,靜等深挖中.

1900/1/1 0:00:00